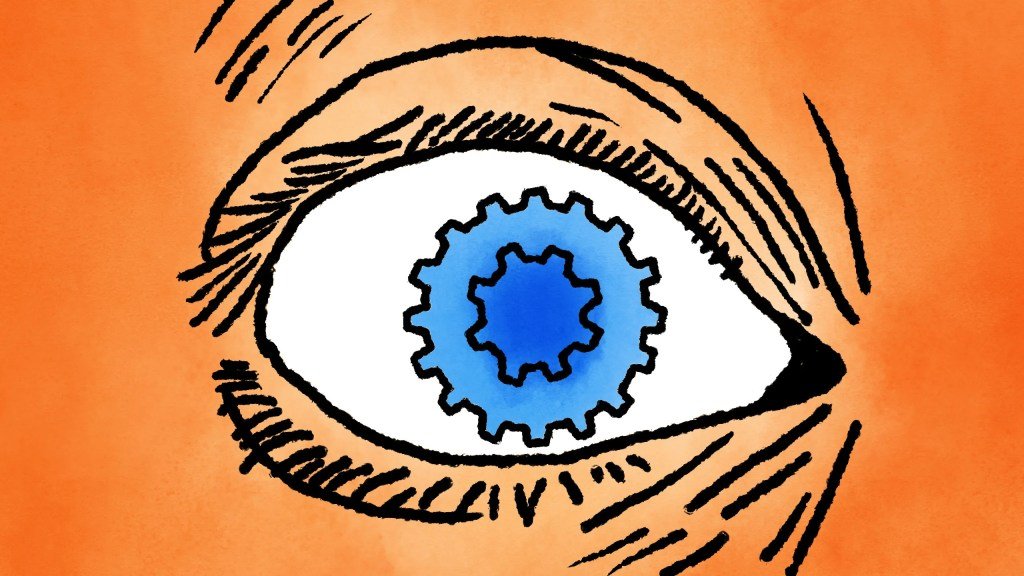

最新一輪的語言模型,如GPT-4o和Gemini 1.5 Pro,被吹捧為“多模式”,能夠理解圖像和聲音以及文本 — 但一項新研究清楚地表明,它們實際上不像你期望的那樣看待。事實上,它們可能根本不看。

要明確地指出,在最初,沒有人提出過“這種AI可以像人一樣看!”(好吧...也許有些人提出過)。但用來宣傳這些模型的營銷和基準使用了像“視覺能力”、“視覺理解”等詞語。他們談論模型如何看待並分析圖像和視頻,這樣它就可以做任何事情,從做作業到幫你看比賽。

因此,盡管這些公司的主張被巧妙地措辭,但明顯地,他們想要表達這種模型在某種意義上是有視覺的。實際上它確實是這樣 — 但和它做數學或寫故事的方式類似:將輸入數據中的模式與其訓練數據中的模式進行匹配。這導致了模型在某些其他看似微不足道的任務上失敗,比如選擇一個隨機數。

奧本大學和阿爾伯塔大學的研究人員進行了一項關於當前AI模型視覺理解的研究,這項研究雖然在某些方面是非正式的,但是系統化。他們給各個最大的多模式模型提出了一系列非常簡單的視覺任務,比如問兩個形狀是否重疊,或者一幅圖片中有幾個五邊形,或者單詞中哪一個字母被標記了。 (可以在這裡查看簡要摘要頁面。)

這些任務甚至是一個一年級學生也能做對的事情,但AI模型卻遇到了極大的困難。

“我們的7個任務非常簡單,人類將以100%的準確率執行。我們期望AI做同樣的事情,但它們目前還未做到,”共同作者Anh Nguyen在給TechCrunch的一封電子郵件中寫道。“我們的信息是‘看,在這些最好的模型仍然失敗了。’”

以重疊形狀測試為例:這是一個最簡單的可想像的視覺推理任務之一。當呈現兩個圓形,可能稍微重疊、剛好接觸或中間有一定距離時,這些模型不能始終正確地完成任務。當它們相距很遠時,確實有95%以上的時間GPT-4o能夠正確完成,但在零或小距離時,只有18%的時間能夠正確完成!Gemini Pro 1.5的表現最好,但在接近距離時仍然只有7/10。

(這些插圖不顯示模型的確切性能,而是旨在展示模型在各種條件下的不一致性。每個模型的統計資料都在論文中。)

那計算圖片中相互鎖定的圓圈數目呢?我敢打賭,一匹優秀的馬都能做到這一點。

當有5個環時,它們都能100%正確地完成 — 做得好,視覺AI!但是當再增加一個環時,結果完全毀了。Gemini迷失了,在一次也沒有正確完成。Sonnet-3.5一次3分之一的機會回答6,而GPT-4o則不到一半的時間。再增加一個環使得情況更加困難,但對某些人來說增加另一個環使得情況變得更容易。

這個實驗的目的僅僅是想表明,無論這些模型正在做什麼,它們並不真正對應我們所認為的看見的樣子。畢竟,即使它們看得不好,我們也不會期望6、7、8和9個環的圖像在成功率上有如此大的差異。

進行的其他測試表現出了類似的模式:他們並不是在理解或推理方面做得好或差,而似乎有一些其他原因造成它們在某些情況下能夠計數,但在其他情況下不能。

這個標誌不僅在訓練數據中反覆出現,而且可能會在其替代文本、使用指南以及有關它的文章中被詳細描述。但是在它們的訓練數據中,哪裡會找到6個環、或7個環呢?根據它們的回應… 並不存在!他們不知道他們在“看”什麼,對於什麼是環、重疊或任何這些概念的實際視覺理解都毫無所知。

我問研究人員對他們所指責的這些模型具有的“盲目性”有何看法。與我們使用的其他術語一樣,它具有一種不能沒有的拟人化的質量,但並不完全準確。

“我同意,“盲目”對於人類而言有很多定義,對於AI而言也還沒有一個確切的詞語來形容這種型式的盲目/對圖像不敏感,”Nguyen寫道。“目前,還沒有技術可以確切可視化模型正在看見什麼。而他們的行為是輸入文本提示、輸入圖像和許多十億個權重的複雜功能。”

他推測,這些模型並不完全是盲目,而是從圖像中提取的視覺信息是模糊且抽象的,類似於“左側有一個圓圈”。但這些模型無法做出視覺判斷,因此它們的回應就像是某人對圖像有所了解但實際上看不到它一樣。

作為最後的例子,Nguyen發送了這個支持上述假設的圖片:

當藍色圓圈和綠色圓圈重疊時(正如問題提示模型應該評估的),通常會產生一個青色陰影區,就像文氏圖中的效果。如果有人問你這個問題,你或任何聰明人可能會給出相同的答案,因為這完全是可以接受的...如果你閉上了眼睛!但是任何睜著眼睛的人都不會那樣回答。

這一切是否意味著這些“視覺”AI模型是無用的?絲毫不是。對某些圖像無法進行基本推理表明了它們的基本功能,但並不表明它們的具體功能。每個模型很可能在人類行為和表情,日常物品和情況的照片等方面非常準確。而這正是它們的設計目的所在。

如果我們依賴AI公司的營銷告訴我們這些模型可以做所有事情,我們將認為它們擁有20/20的視力。像這樣的研究是必要的,以表明,無論模型在判斷一個人是坐著還是走路或跑步方面有多準確,它們都是在沒有“看見”的情況下執行的。